核心思路

自动拆分快递信息的核心思想是“模式识别 + 规则提取”,快递信息虽然千变万化,但其内部结构通常遵循一定的模式,我们的任务就是找到这些模式,并用程序将其解析成结构化的数据。

一个典型的快递单号信息通常包含以下几个部分:

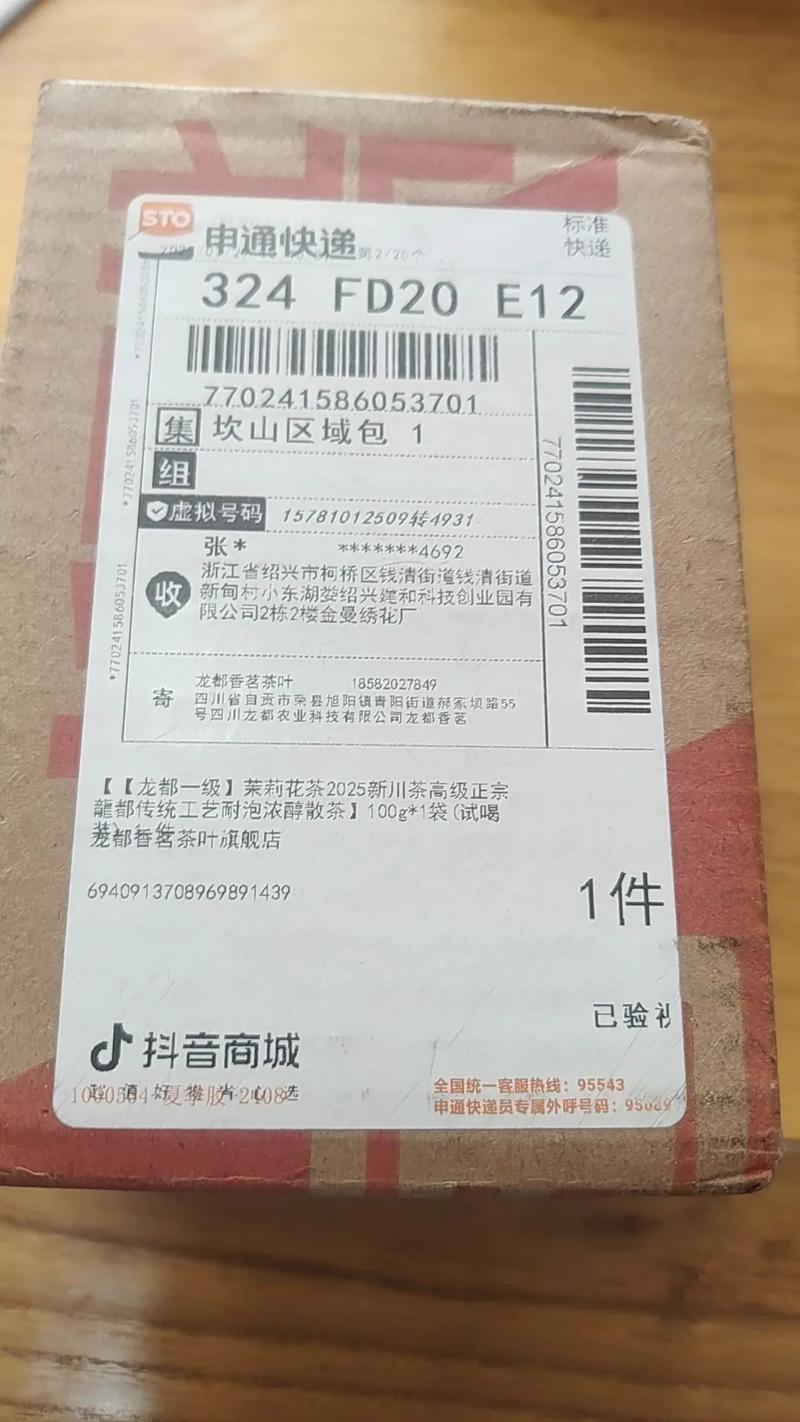

(图片来源网络,侵删)

- 快递公司: 如顺丰、中通、圆通、京东等。

- 快递单号: 一串由字母和数字组成的唯一编码。

- 物流状态: 如“已揽收”、“运输中”、“派送中”、“已签收”等。

- 时间戳: 对应物流状态发生的时间,如

2025-10-27 14:30:00。 - 描述信息: 如“快件已由[快递员姓名]揽收”、“快件正在派送”等。

- 来源地/目的地: 如“北京市朝阳区”、“广州市天河区”等。

实现自动拆分主要有以下三种方法,可以根据您的具体需求(如信息格式是否统一、对准确率的要求等)进行选择或组合。

基于规则和正则表达式(最常用)

这是最直接、最高效的方法,适用于信息格式相对固定的场景,它的核心是编写规则(特别是正则表达式)来匹配和提取信息。

优点:

- 速度快:纯文本匹配,计算开销小。

- 逻辑清晰:规则明确,易于理解和调试。

- 准确率高:对于规则明确的文本,准确率接近100%。

缺点:

- 维护成本高:当快递公司更新信息格式或出现新格式时,需要手动修改规则。

- 灵活性差:难以处理非结构化或格式混乱的文本。

实现步骤:

-

识别快递公司:

- 可以通过关键词匹配,如

if "顺丰" in text: company = "SF Express"。 - 更可靠的方法是维护一个快递公司列表,根据列表中的关键词进行匹配。

- 可以通过关键词匹配,如

-

提取快递单号:

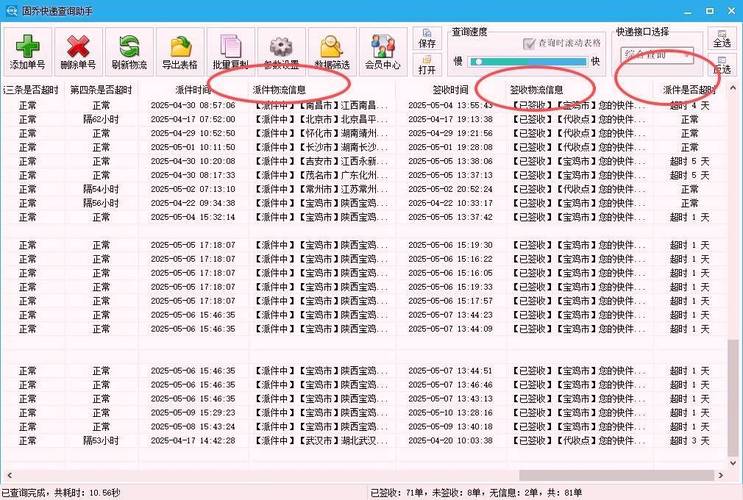

(图片来源网络,侵删)

(图片来源网络,侵删)- 这是最关键的一步,不同快递公司的单号有固定的长度和字符集。

- 顺丰:通常12位纯数字。

- 中通:通常12位纯数字。

- 圆通:单号通常以

YTO开头,后面跟着10-12位数字。 - 京东:通常以

JD开头,后面跟着12-16位数字。 - 韵达:通常以

YD开头,后面跟着13位数字。 - 通用方法:可以编写一个正则表达式,匹配所有已知的单号模式。

-

提取物流状态和时间:

- 状态和时间通常成对出现,

2025-10-27 14:30:00 快件已揽收。 - 可以用正则表达式匹配时间格式(如

\d{4}-\d{2}-\d{2} \d{2}:\d{2}:\d{2}),然后取其后的描述作为状态。

- 状态和时间通常成对出现,

代码示例 (Python):

import re

# 定义快递公司及其单号正则表达式

# 这是一个简化版的示例,实际应用中需要更全面的规则库

COURIER_RULES = [

{

"name": "SF Express",

"pattern": r"(顺丰|SF|顺丰速运)[^0-9]*(\d{12})",

"status_keywords": ["已揽收", "运输中", "派送中", "已签收"]

},

{

"name": "ZTO Express",

"pattern": r"(中通|ZTO)[^0-9]*(\d{12})",

"status_keywords": ["已揽收", "运输中", "派送中", "已签收"]

},

{

"name": "YTO Express",

"pattern": r"(圆通|YTO)[^0-9]*([A-Z]{3}\d{10,12})",

"status_keywords": ["已揽收", "运输中", "派送中", "已签收"]

}

]

def parse_courier_info(text):

"""

解析快递信息

:param text: 原始文本,如 "【顺丰速运】您的快件 123456789012 已揽收。"

:return: 包含解析结果的字典

"""

result = {

"company": None,

"tracking_number": None,

"status": None,

"timestamp": None,

"raw_text": text

}

# 1. 识别快递公司和单号

for rule in COURIER_RULES:

match = re.search(rule["pattern"], text)

if match:

result["company"] = rule["name"]

result["tracking_number"] = match.group(2)

break

if not result["tracking_number"]:

return {"error": "无法识别快递单号", "raw_text": text}

# 2. 提取时间戳 (假设时间格式为 YYYY-MM-DD HH:MM:SS)

time_match = re.search(r"(\d{4}-\d{2}-\d{2} \d{2}:\d{2}:\d{2})", text)

if time_match:

result["timestamp"] = time_match.group(1)

# 3. 提取物流状态

for keyword in COURIER_RULES[0]["status_keywords"]: # 使用第一个规则的状态关键词作为示例

if keyword in text:

result["status"] = keyword

break

return result

# --- 测试 ---

text1 = "【顺丰速运】您的快件 123456789012 已于 2025-10-27 14:30:00 拣件完成,正在等待发出。"

text2 = "中通快递:运单号 987654321098,2025-10-26 10:00:00 快件已由快递员揽收。"

text3 = "圆通 YTOA1234567890,包裹正在派送中,请保持电话畅通。"

print(parse_courier_info(text1))

print(parse_courier_info(text2))

print(parse_courier_info(text3))

使用命名实体识别

对于更复杂、更非结构化的文本(如聊天记录、用户评论),NER是更强大的工具,NER可以像人一样阅读文本,并识别出“人名”、“地名”、“组织机构名”等预定义的实体类型。

优点:

- 处理非结构化文本能力强:能适应各种口语化、不规范的表述。

- 扩展性好:可以轻松添加新的实体类型(如“快递单号”本身就是一种自定义实体)。

缺点:

- 需要训练数据:要获得高准确率,需要大量标注好的训练数据。

- 计算成本高:比正则表达式慢。

- 模型选择:需要选择合适的预训练模型或进行微调。

实现步骤:

- 选择NER框架:如

spaCy(英文和中文)、Stanford NER、HanLP(中文) 或基于深度学习的Hugging Face Transformers。 - 定义实体类型:将“快递公司”、“快递单号”、“时间”、“地点”等定义为需要识别的实体。

- 训练或微调模型:使用带有这些实体标注的数据集来训练或微调一个NER模型。

- 应用模型:将新的快递信息文本输入模型,模型会输出每个词及其对应的实体标签。

代码示例 (使用 spaCy 和自定义训练):

这是一个高级用法,通常需要一个完整的训练流程,这里仅展示其应用思路。

# 这是一个概念性示例,实际运行前需要先训练好模型

# import spacy

# nlp = spacy.load("your_custom_courier_model") # 加载你训练好的模型

# doc = nlp("顺丰的快递单号 123456789012 已经签收了,是昨天下午签的。")

# for ent in doc.ents:

# print(f"实体: {ent.text}, 类型: {ent.label_}")

# # 预期输出可能类似于:

# # 实体: 顺丰, 类型: COURIER_COMPANY

# # 实体: 123456789012, 类型: TRACKING_NUMBER

# # 实体: 昨天, 类型: TIME

使用大语言模型

这是目前最灵活、最强大的方法,利用像 GPT-4、文心一言、通义千问等大语言模型的理解和生成能力。

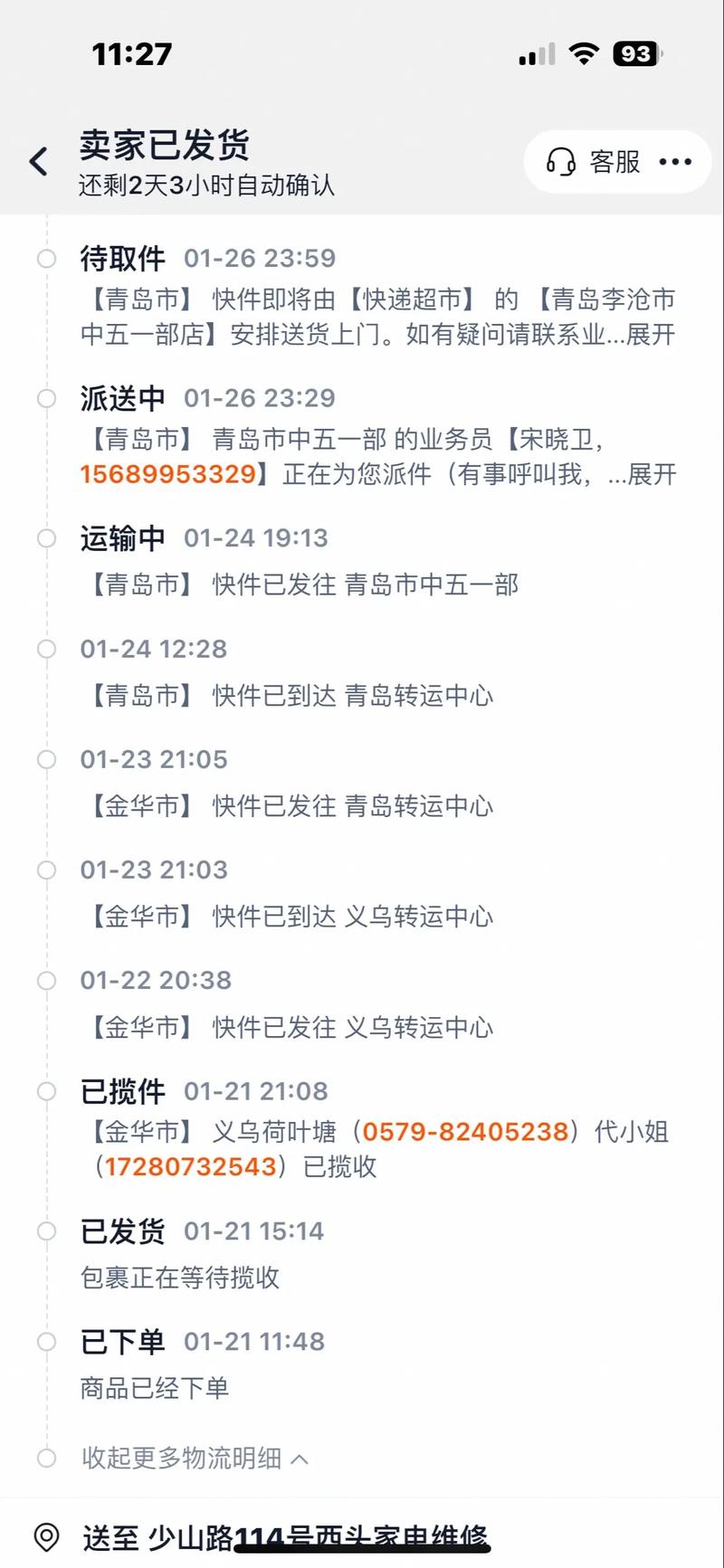

(图片来源网络,侵删)

优点:

- 几乎零规则编写:通过自然语言指令(Prompt)告诉模型你想要什么。

- 理解能力极强:能处理模糊、复杂、口语化的指令。

- 快速验证:可以快速尝试不同的拆分方式,无需重新训练模型。

缺点:

- 成本高:API调用通常按 token 计费。

- 速度慢:网络请求和模型推理耗时较长,不适合高并发的实时任务。

- 依赖外部服务:需要稳定的网络连接和API访问权限。

实现步骤:

- 设计一个清晰的 Prompt:告诉模型你的输入是什么,期望的输出格式是什么。

- 调用API:将 Prompt 和原始文本发送给大语言模型的API。

- 解析结果:模型会返回结构化的文本(通常是JSON),你只需解析它即可。

代码示例 (使用 OpenAI API):

import openai

import json

# 设置你的 API Key

# openai.api_key = "YOUR_API_KEY"

def parse_with_llm(text):

prompt = f"""

你是一个专业的物流信息解析助手。

请从以下快递信息中提取关键数据,并以JSON格式返回。

如果某个字段无法确定,请将其值设为 null。

信息文本: "{text}"

请按以下JSON格式返回:

{{

"company": "快递公司名称",

"tracking_number": "快递单号",

"status": "物流状态",

"timestamp": "时间戳",

"description": "其他描述信息"

}}

"""

try:

response = openai.chat.completions.create(

model="gpt-3.5-turbo", # 或 gpt-4

messages=[

{"role": "system", "content": "你是一个JSON格式的数据提取助手。"},

{"role": "user", "content": prompt}

],

temperature=0.1 # 降低随机性,使输出更稳定

)

result_text = response.choices[0].message.content

# 清理可能存在的 markdown 代码块标记

result_text = result_text.replace("```json", "").replace("```", "").strip()

return json.loads(result_text)

except Exception as e:

return {"error": f"LLM解析失败: {e}", "raw_text": text}

# --- 测试 ---

text = "京东快递的包裹 JD98765432123456 已经在昨天上午10点由快递员老王派送到了,但我没收到。"

print(parse_with_llm(text))

综合建议与最佳实践

在实际项目中,通常不会只依赖单一方法,而是采用混合策略:

-

优先使用正则表达式:对于80%格式规范的来源(如官方API、标准短信),使用正则表达式进行快速、准确的解析,这是你的第一道防线,也是最高效的。

-

LLM作为兜底和补充:

- 对于无法被正则表达式匹配的“疑难杂症”文本,将其交给LLM处理。

- 可以设置一个规则:如果正则表达式提取失败,或者提取出的置信度较低(单号长度不对),则自动调用LLM进行二次解析。

- 这样既能保证大部分场景下的高性能,又能处理少数复杂情况。

-

持续优化规则库:

- 建立一个日志系统,记录所有解析失败或解析结果可疑的原始文本。

- 定期分析这些日志,发现新的快递信息格式或模式,然后将其更新到你的正则表达式规则库中,这是一个持续迭代的过程。

-

考虑使用现成的服务:

如果你的核心业务不是物流,可以考虑使用第三方的快递查询API服务,这些服务通常已经内置了全国各大快递公司的解析和查询能力,你只需提供单号,它们就能返回结构化的物流信息,这能让你专注于自己的核心业务开发。

希望这份详细的指南能帮助您实现快递信息的自动拆分!